DeepMind, le laboratoire de recherche et développement de Google sur l’IA, pense que la clé de systèmes d’IA plus performants pourrait résider dans la découverte de nouvelles façons de résoudre des problèmes de géométrie difficiles.

À cette fin, DeepMind a dévoilé aujourd’hui AlphaGeometry, un système qui, selon le laboratoire, peut résoudre autant de problèmes de géométrie que la moyenne des médaillés d’or des Olympiades internationales de mathématiques. AlphaGeometry, dont le code a été rendu public ce matin, résout 25 problèmes de géométrie des Olympiades dans le temps imparti, contre 10 pour le système de pointe précédent.

« La résolution de problèmes de géométrie de niveau olympique est une étape importante dans le développement du raisonnement mathématique profond sur la voie de systèmes d’IA plus avancés et plus généraux », ont écrit Trieu Trinh et Thang Luong, chercheurs en IA chez Google, dans un billet de blog publié ce matin. « Nous espérons qu’AlphaGeometry contribuera à ouvrir de nouvelles possibilités dans les domaines des mathématiques, de la science et de l’IA.

Pourquoi se concentrer sur la géométrie ? DeepMind affirme que prouver des théorèmes mathématiques ou expliquer logiquement pourquoi un théorème (par exemple le théorème de Pythagore) est vrai, nécessite à la fois un raisonnement et la capacité de choisir parmi une série d’étapes possibles pour parvenir à une solution. Cette approche de la résolution de problèmes pourrait, si DeepMind a raison, s’avérer un jour utile dans les systèmes d’IA à usage général.

« Démontrer qu’une conjecture particulière est vraie ou fausse dépasse les capacités des systèmes d’IA les plus avancés aujourd’hui », peut-on lire dans les documents de presse de DeepMind partagés avec TechCrunch. « Dans cette optique, être capable de prouver des théorèmes mathématiques (…) est une étape importante, car cela démontre la maîtrise du raisonnement logique et la capacité à découvrir de nouvelles connaissances. »

Mais former un système d’IA à la résolution de problèmes de géométrie pose des défis uniques.

En raison de la complexité de la traduction des preuves dans un format compréhensible par les machines, il y a une pénurie de données utilisables pour l’entraînement à la géométrie. De plus, de nombreux modèles d’IA générative de pointe, bien qu’exceptionnels pour identifier des modèles et des relations dans les données, n’ont pas la capacité de raisonner logiquement à travers les théorèmes.

La solution de DeepMind était double.

Crédits images : DeepMind

Lors de la conception d’AlphaGeometry, le laboratoire a associé un modèle de « langage neuronal » – un modèle architecturé selon les lignes de ChatGPT – à un « moteur de déduction symbolique », un moteur qui s’appuie sur des règles (par exemple, des règles mathématiques) pour déduire des solutions à des problèmes. Les moteurs symboliques peuvent être peu flexibles et lents, en particulier lorsqu’ils traitent des ensembles de données volumineux ou compliqués. Mais DeepMind a atténué ces problèmes en faisant en sorte que le modèle neuronal « guide » le moteur de déduction à travers les réponses possibles à des problèmes de géométrie donnés.

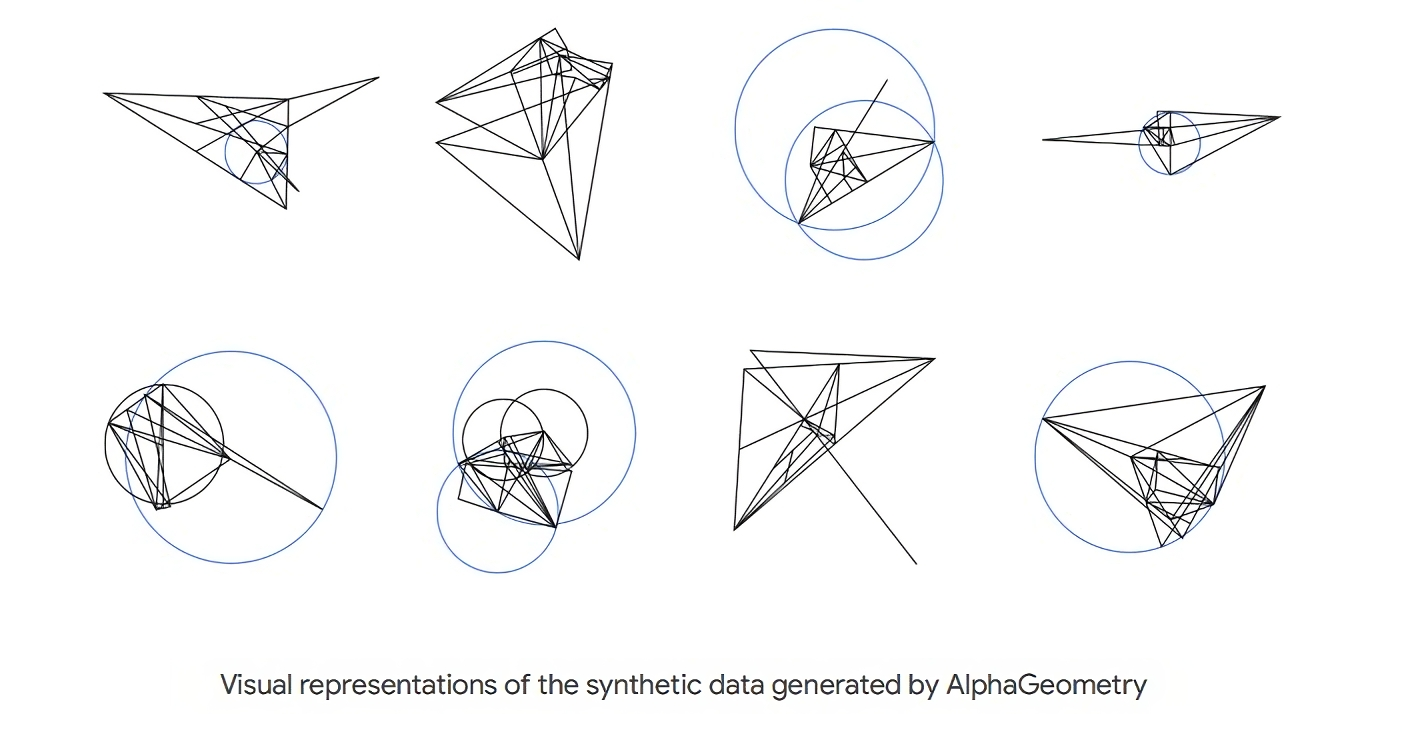

Au lieu d’utiliser des données d’entraînement, DeepMind a créé son propre modèle neuronal. synthétiques , générant 100 millions de « théorèmes synthétiques » et de preuves de complexité variable. Le laboratoire a ensuite formé AlphaGeometry à partir de zéro sur les données synthétiques et l’a évalué sur des problèmes de géométrie des Olympiades.

Les problèmes de géométrie des Olympiades sont basés sur des diagrammes qui nécessitent l’ajout de « constructions » avant de pouvoir être résolus, comme des points, des lignes ou des cercles. Appliqué à ces problèmes, le modèle neuronal d’AlphaGeometry prédit quelles constructions pourraient être utiles à ajouter – prédictions que le moteur symbolique d’AlphaGeometry utilise pour faire des déductions sur les diagrammes afin d’identifier des solutions similaires.

« Avec tant d’exemples de la façon dont ces constructions ont conduit à des preuves, le modèle de langage d’AlphaGeometry est capable de faire de bonnes suggestions pour de nouvelles constructions lorsqu’on lui présente des problèmes de géométrie des Olympiades », écrivent Trinh et Luong. « Un système fournit des idées rapides et ‘intuitives’, et l’autre une prise de décision plus délibérée et rationnelle.

Les résultats de la résolution de problèmes par AlphaGeometry, qui ont été publiés dans une étude parue cette semaine dans la revue Nature, sont susceptibles d’alimenter le débat de longue date sur la question de savoir si les systèmes d’IA doivent être construits sur la base de la manipulation de symboles – c’est-à-dire la manipulation de symboles qui représentent des connaissances à l’aide de règles – ou sur les réseaux neuronaux, qui sont ostensiblement plus proches du cerveau.

Les partisans de l’approche des réseaux neuronaux soutiennent qu’un comportement intelligent – de la reconnaissance vocale à la génération d’images – peut émerger à partir de quantités massives de données et de calculs. Contrairement aux les systèmes symboliques, qui résolvent les tâches en définissant des ensembles de règles de manipulation de symboles dédiés à des tâches particulières (comme l’édition d’une ligne dans un logiciel de traitement de texte), les réseaux neuronaux tentent de résoudre les tâches par approximation statistique et apprentissage à partir d’exemples.

Les réseaux neuronaux sont la pierre angulaire de puissants systèmes d’IA tels que DALL-E 3 et GPT-4 d’OpenAI. Mais, selon les partisans de l’IA symbolique, ils ne sont pas la panacée ; l’IA symbolique pourrait être mieux placée pour encoder efficacement la connaissance du monde, raisonner à travers des scénarios complexes et « expliquer » comment elle est parvenue à une réponse, affirment ces partisans.

En tant que système hybride de réseaux symboliques et neuronaux, semblable à AlphaFold 2 et AlphaGo de DeepMind, AlphaGeometry démontre peut-être que les deux approches – la manipulation de symboles et les réseaux neuronaux – sont en train de se compléter et de s’influencer mutuellement. combinées est la meilleure voie à suivre dans la recherche d’une IA généralisable. Peut-être.

« Notre objectif à long terme reste de construire des systèmes d’IA capables de se généraliser dans les domaines mathématiques, en développant la résolution de problèmes et le raisonnement sophistiqués dont dépendront les systèmes d’IA généraux, tout en repoussant les frontières de la connaissance humaine », écrivent Trinh et Luong. « Cette approche pourrait façonner la manière dont les systèmes d’IA du futur découvriront de nouvelles connaissances, en mathématiques et ailleurs.