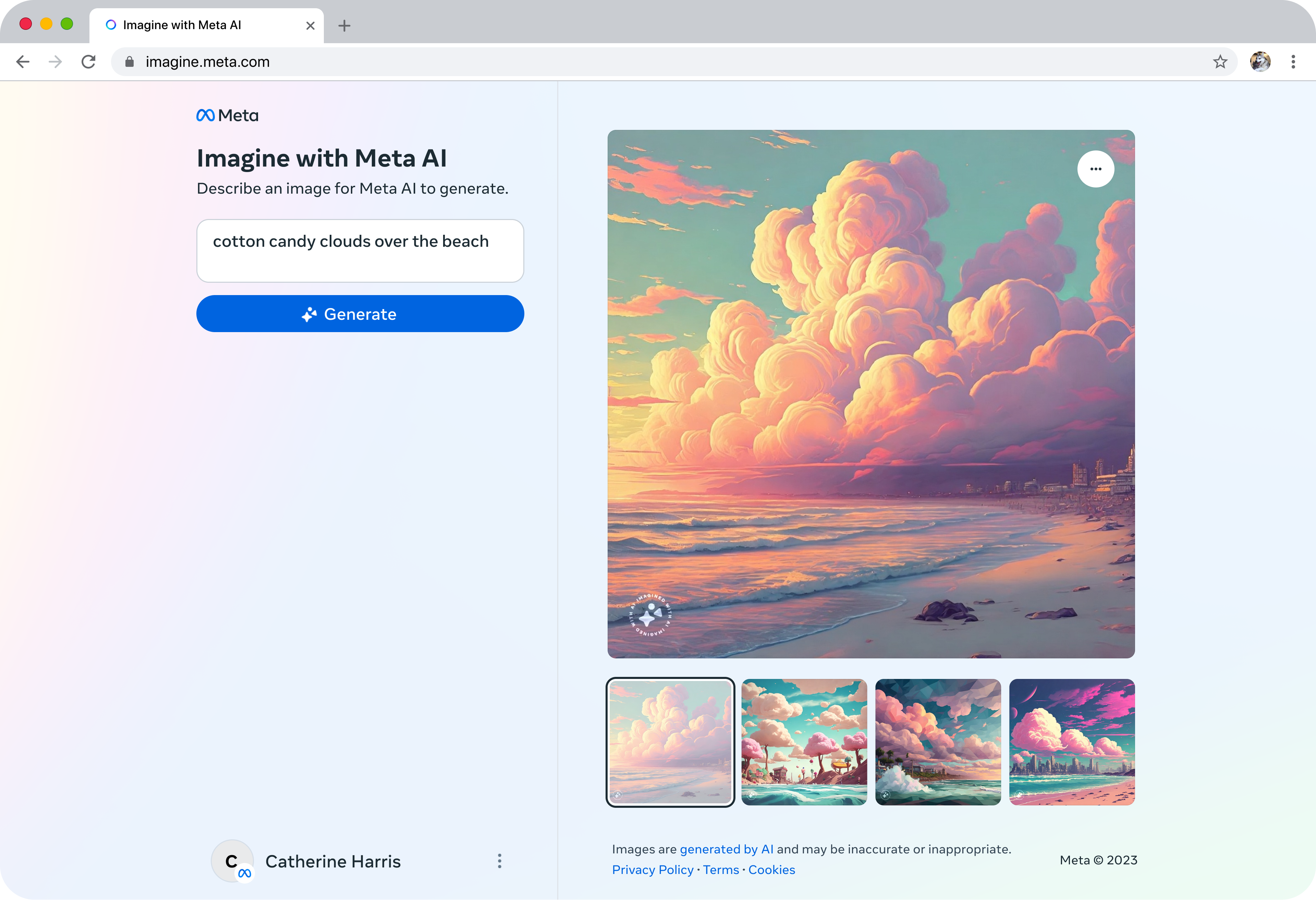

Ne se laissant pas distancer par le lancement de Gemini par Google, Meta lance une nouvelle expérience d’IA générative autonome sur le web, Imagine with Meta, qui permet aux utilisateurs de créer des images en les décrivant en langage naturel.

Similaire à DALL-E, Midjourney et Stable Diffusion d’OpenAI, Imagine with Meta, qui s’appuie sur le modèle de génération d’images Emu de Meta, crée des images haute résolution à partir d’invites textuelles. Son utilisation est gratuite (du moins pour l’instant) pour les utilisateurs aux États-Unis et génère quatre images par message-guide.

« Nous avons apprécié les commentaires de nos utilisateurs sur la façon dont ils utilisent imagine, la fonction de génération d’images à partir de texte de Meta AI, pour créer du contenu amusant et créatif dans les chats. Aujourd’hui, nous élargissons l’accès à imagine en dehors des chats », écrit Meta dans un billet de blog publié ce matin. « Bien que notre expérience de messagerie soit conçue pour des interactions plus ludiques, vous pouvez désormais créer des images libres sur le web également. »

Crédits d’image : Imaginez avec Meta

Les outils de génération d’images de Meta ont récemment mis l’entreprise dans l’eau chaude (voir : le générateur d’autocollants AI à caractère raciste de Meta), ce qui amène cet auteur à se demander si Imagine with Meta comporte des garanties pour éviter que l’histoire ne se répète. Nous n’avons pas eu l’occasion de tester l’outil avant son lancement, mais soyez assurés que nous garderons un œil attentif sur Imagine with Meta au fur et à mesure que le nombre d’utilisateurs augmentera.

Les filigranes ne seront pas visibles dès le début, mais Meta s’est engagé à commencer à ajouter des filigranes au contenu généré par Imagine with Meta dans les semaines à venir pour « une transparence et une traçabilité accrues ». (Les filigranes, invisibles, seront générés à l’aide d’un modèle d’intelligence artificielle et détectables à l’aide d’un modèle correspondant, selon Meta. Il n’est pas précisé si le modèle de détection sera rendu public à un moment ou à un autre.

Crédits d’image : Meta

« (Les filigranes) résistent aux manipulations d’images courantes telles que le recadrage, le redimensionnement, le changement de couleur (luminosité, contraste, etc.), les captures d’écran, la compression d’image, le bruit, les superpositions d’autocollants et bien d’autres choses encore », a déclaré Meta dans son billet. « Nous avons l’intention d’intégrer à l’avenir des filigranes invisibles dans un grand nombre de nos produits avec des images générées par l’IA. »

Les techniques de filigrane pour l’art génératif ne sont pas nouvelles. La startup française Imatag propose un outil de filigrane qui, selon elle, n’est pas affecté par le redimensionnement, le recadrage, l’édition ou la compression des images. Une autre entreprise, Steg.AI, utilise un modèle d’intelligence artificielle pour appliquer des filigranes qui résistent au redimensionnement et à d’autres modifications. Microsoft et Google ont adopté des normes et des technologies de filigrane basées sur l’IA, tandis qu’ailleurs, Shutterstock et Midjourney ont accepté des lignes directrices pour intégrer des marqueurs indiquant que leur contenu a été créé par un outil d’IA génératif.

Mais la pression s’intensifie sur les entreprises technologiques pour qu’elles indiquent plus clairement que les œuvres ont été générées par l’IA – en particulier à la lumière de l’avalanche de Deepfakes de la guerre de Gaza et des images d’abus d’enfants générées par l’IA qui contournent les filtres.

Récemment, l’administration chinoise du cyberespace a publié des règlements exigeant que les fournisseurs d’IA générative marquent le contenu généré – y compris les générateurs de textes et d’images – sans affecter l’utilisation par les utilisateurs. Lors de récentes auditions devant une commission du Sénat américain, la sénatrice Kyrsten Sinema (I-AZ) a insisté sur la nécessité d’assurer la transparence de l’IA générative, notamment par l’utilisation de filigranes.