DynamoFL, qui propose des logiciels permettant aux entreprises d’utiliser de grands modèles de langage (LLM) et d’affiner ces modèles sur des données sensibles, a annoncé aujourd’hui avoir levé 15,1 millions de dollars dans le cadre d’un tour de table de série A co-dirigé par Canapi Ventures et Nexus Venture Partners.

Cette tranche, avec la participation de Formus Capital et Soma Capital, porte le total des fonds levés par DynamoFL à 19,3 millions de dollars. Vaikkunth Mugunthan, cofondateur et PDG de DynamoFL, explique que les fonds seront consacrés à l’élargissement de l’offre de produits de DynamoFL et à la croissance de son équipe de chercheurs en matière de protection de la vie privée.

« Dans l’ensemble, l’offre de produits de DynamoFL permet aux entreprises de développer des solutions LLM privées et conformes sans compromettre les performances », a déclaré Mugunthan à TechCrunch lors d’un entretien par courrier électronique.

DynamoFL, basée à San Francisco, a été fondée en 2021 par Mugunthan et Christian Lau, tous deux diplômés du département d’ingénierie électrique et d’informatique du MIT. Mugunthan dit qu’ils ont été motivés pour lancer la société par un désir commun de remédier aux vulnérabilités « critiques » en matière de sécurité des données dans les modèles d’IA.

L’IA générative a fait apparaître de nouveaux risques, notamment la possibilité pour les LLM de « mémoriser » des données d’entraînement sensibles et de les divulguer à des acteurs malveillants », a déclaré M. Mugunthan. « Les entreprises ont été mal équipées pour faire face à ces risques, car pour traiter correctement les vulnérabilités des LLM, il faudrait recruter des équipes de chercheurs hautement spécialisés dans l’apprentissage automatique de la vie privée afin de créer une infrastructure rationalisée pour tester en permanence leurs LLM contre les vulnérabilités émergentes en matière de sécurité des données. »

Les entreprises rencontrent certainement des difficultés – principalement liées à la conformité – lorsqu’elles adoptent les LLM à leurs fins. Elles craignent que leurs données confidentielles ne se retrouvent entre les mains des développeurs qui ont formé les modèles à partir des données des utilisateurs. Ces derniers mois, de grandes entreprises comme Apple, Walmart et Verizon ont interdit à leurs employés d’utiliser des outils tels que ChatGPT d’OpenAI.

Dans un rapport récent, Gartner a identifié six risques juridiques et de conformité que les organisations doivent évaluer pour un risque LLM « responsable », notamment le potentiel des LLM à répondre aux questions de manière inexacte (un phénomène connu sous le nom d’hallucination), la confidentialité des données et la partialité du modèle (par exemple, lorsqu’un modèle associe de manière stéréotypée certains sexes à certaines professions). Le rapport note que ces exigences peuvent varier en fonction de l’État et du pays, ce qui complique les choses ; la Californie, par exemple, impose aux organisations de divulguer lorsqu’un client communique avec un robot.

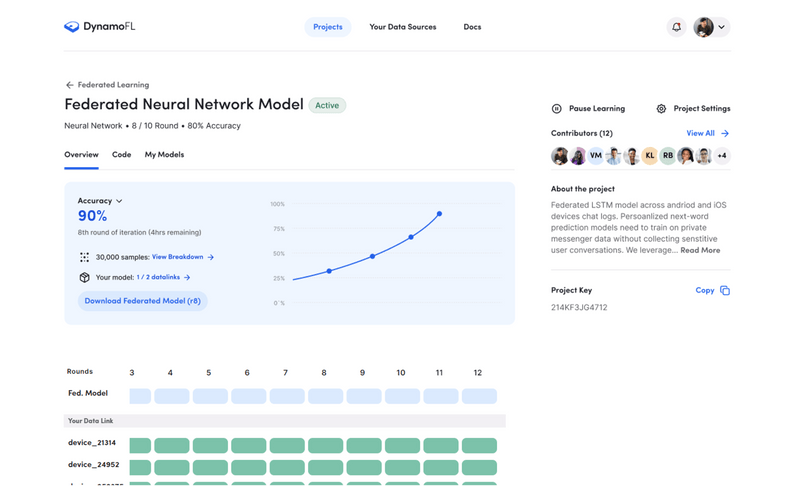

Crédits images : DynamoFL

DynamoFL, qui est déployé sur le nuage privé virtuel d’un client ou sur site, tente de résoudre ces problèmes de différentes manières, notamment avec un outil de test de pénétration LLM qui détecte et documente les risques de sécurité des données LLM, par exemple si un LLM a mémorisé ou pourrait divulguer des données sensibles. Plusieurs études ont montré que les LLM, selon la manière dont ils sont formés et sollicités, peuvent exposer des informations personnelles – un anathème évident pour les grandes entreprises qui travaillent avec des données propriétaires.

En outre, DynamoFL fournit une plateforme de développement LLM qui incorpore des techniques visant à atténuer les risques de fuite de données et les vulnérabilités en matière de sécurité. Grâce à cette plateforme, les développeurs peuvent intégrer diverses optimisations dans les modèles, ce qui leur permet également de fonctionner dans des environnements où le matériel est limité, tels que les appareils mobiles et les serveurs périphériques.

Ces capacités ne sont pas particulièrement uniques, pour être clair – du moins pas à première vue. Des startups comme OctoML, Seldon et Deci fournissent des outils pour optimiser les modèles d’IA afin qu’ils s’exécutent plus efficacement sur une variété de matériel. D’autres, comme LlamaIndex et Contextual AI, se concentrent sur la protection de la vie privée et la conformité – en fournissant des moyens de préserver la vie privée pour former les LLM sur des données de première main.

Qu’est-ce qui différencie DynamoFL ? La « rigueur » de ses solutions, affirme Mugunthan. Il s’agit notamment de travailler avec des experts juridiques pour élaborer la manière d’utiliser DynamoFL afin de développer des LLM en conformité avec les lois américaines, européennes et asiatiques sur la protection de la vie privée.

L’approche a attiré plusieurs clients de Fortune 500, en particulier dans les secteurs de la finance, de l’électronique, de l’assurance et de l’automobile.

« Bien qu’il existe aujourd’hui des produits pour expurger les informations personnellement identifiables des requêtes envoyées aux services LLM, ceux-ci ne répondent pas aux exigences réglementaires strictes dans des secteurs tels que les services financiers et l’assurance, où les informations personnellement identifiables expurgées sont couramment réidentifiées par le biais d’attaques malveillantes sophistiquées », a-t-il déclaré. « DynamoFL s’est appuyé sur l’expertise de son équipe en matière de vulnérabilités de l’IA pour construire la solution la plus complète pour les entreprises qui cherchent à satisfaire les exigences réglementaires en matière de sécurité des données LLM. »

DynamoFL n’aborde pas l’un des problèmes les plus épineux des LLM d’aujourd’hui : les risques liés à la propriété intellectuelle et aux droits d’auteur. Les LLM commerciaux sont formés sur une grande quantité de données Internet, et parfois, ils régurgitent ces données – ce qui expose toute entreprise qui les utilise à un risque de violation des droits d’auteur.

Mais Mugunthan a fait allusion à un ensemble élargi d’outils et de solutions à venir, alimenté par le financement récent de DynamoFL.

« Répondre aux exigences des régulateurs est une responsabilité essentielle pour les responsables du département informatique, en particulier dans des secteurs tels que les services financiers et les assurances », a-t-il déclaré. « Le non-respect de la réglementation peut entraîner des dommages irréparables à la confiance des clients en cas de fuite d’informations sensibles, des amendes sévères et des perturbations majeures dans les opérations d’une entreprise. La suite d’évaluation de la confidentialité de DynamoFL fournit des tests prêts à l’emploi pour les vulnérabilités d’extraction de données et la documentation automatisée requise pour répondre aux exigences de sécurité et de conformité ».

DynamoFL, qui emploie actuellement une équipe d’environ 17 personnes, prévoit d’avoir 35 employés d’ici la fin de l’année.